Confiemos todos en OpenAI que no pasa nada

Se que ChatGPT es un fenómeno social o una idea que se vende bien, pero también se que demasiado éxito trae ciertas desventajas que el ser humano tradicional no les suele prestar atención, o bien, no le interesa saber. Y estoy hablando del manejo de la información del usuario, o mejor conocido como política de privacidad.

La política de privacidad es un texto o manifiesto por parte de las empresas donde, estan obligados a decir que hacen con tu información recolectada u obtenida y como la usan. Soy de los que creen que una cosa es decir, y otra es hacer.

Recolección de data.

OpenAI, dice en su web de política de privacidad, que recolectan información de la siguiente manera, y voy a escribirlo de una manera amigable para el medio ambiente:

Información que el usuario brinda.

Recolectan información que aceptás compartir con ellos al crearte la cuenta, de una manera directa:

- Información de cuenta: obtienen tu nombre, información de contacto, credenciales (tu contraseña), fecha de nacimiento, método de pago (sip, tienen tu tarjeta), e historial de pagos. Si bien acá la información podemos mentir, la tarjeta es algo que se complica, entiendo que no se van a quemar y usar tu tarjeta, pero desde mi punto de vista no es conveniente que guarden una tarjeta en sus servidores.

- Contenido del usuario: todo lo que se refiere al input o ingreso de elementos en la web, como texto, imagenes, audio y todo lo que podes interactuar con ChatGPT, se lo quedan. Si alguna vez subiste la foto de tu perrita para que la "dibuje" como Estudio Ghibli, ya la tienen guardada ahí con ellos.

- Información de comunicación: esto es un toque más raro porque no solemos interactuar con ellos a través de mail o canales de comunucación, pero si les mandas un DM por Instagram, lo guardan y lo asocian a tu perfil.

Información recolectada por el uso del servicio.

Acá viene lo interesante, y es la información que invisiblemente se comparte con ellos al utilizar el servicio:

- Logs: recolectan la información de tu navegador o dispositivo, y eso incluye la dirección IP del dispositivo (es decir esa huella única que tenés en internet que está asociado a tu país y ubicación), tipo y ajustes del navegador, si navegás con Chrome lo van a saber y que ajustes tenes, si tenes una cuenta asociada al navegador lo van a saber, incluso si guardaste una contraseña lo van a saber.

- Información de dispositivo: como el nombre lo indica, saben desde que dispositivo estás usando el servicio, si bien no es crítico para el usuario, es altamente valuable para la empresa, de esta manera saben si usas iPhone o Android, o desde la pc, o tablet, etc. (Voy a comentar porque es super importante esto más adelante).

- Ubicación: dicen que es por seguridad, que detectan los inicios de sesión y guardan las IPs para ver si hay algún inicio raro, incluso dependiendo del dispositivo, tienen el acceso a la ubicación mediante IP y triangulación mediante GPS, es decir, ubicación exacta.

Además también en su texto, indican que reciben información de partners para detectar fraudes (what, como y por que), detectar amenazas y también, de empresas de marketing. Opa, eso si que llama la atención para que querría OpenAI o ChatGPT recibir información de empresas de marketing. Suponete que mirás un auto en MercadoLibre, eso se comparte con ellos, y pronto sabremos lo que hacen ellos con dicha información.

Como usan la data recolectada.

Según ellos, o lo que dicen en su texto, usan la información obtenida de la siguiente manera:

- Para analizar, mantener y entrenar las respuestas de ChatGPT.

- Para mejorar y desarrollar los servicios o nuevos servicios. Opa.

- Para prevenir fraude o amenazas.

A su vez, dicen que podrían compartir la información con vendedores y servicios que lo requieran, para que ellos los ayuden a mejorar sus servicios, o conocidos como Third Party, también podrían compartir información si están realizando una actividad económica empresarial. Si los goviernos necesitan información tuya, ellos se abren de piernas porque están obligados. También podrían compartir la información con afiliados (???).

Si hasta acá, nada te llama la atención, dejame comentarte un poco más sobre como verdaderamente laburan ellos con tu información. Spoiler: la información es el negocio del futuro, no importa cuando leas esto.

OpenAI, vende tu data?

Según un artículo de en Freedium (chupate un culo Medium), OpenAI logró tener en su billetera un poco más de 10 billones en el 2023, y eso llamó la atención de algunos. Entre tanto texto explican que OpenAI hace dinero "limpiamente" vendiendo suscripciones de ChatGPT a empresas, o empresaurios.

Entonces, si analizamos eso, sabemos que no están veniendo nuestra información directamente a un tercero o a una empresa, PERO, están usando nuestra información para mejorar sus servicios para poder venderselos a terceros. Imaginate entonces, que sos escritor, pasaste todo tu libro por ChatGPT por alguna razón que desconozco, y esa información ahora les pertenece a ChatGPT, y además los ayudaste gratuitamente a mejorar su servicio. Y ojo, que por ahí te ayudó a vos también como escritor pero estoy seguro que lo podías resolver sin necesidad de pasarlo a ChatGPT.

Y otra cosa que me preocupa es, con tanta Inteligencia Artificial delante, hay demasiados vagos detrás, y si el vago que tiene que encriptar la información por algún motivo se olvida, problemas ocurren y no hay AI que te salve.

Entonces?

Mi conclusión es que, generaron el modelo de negocios perfecto para vender la idea de reemplazar al humano. La idea de que la IA nos va a reemplazar es algo conocido como terapia del shock en muchísima menor escala, es decir que mediante el miedo podrían mantenernos controlados, pero no es que nos van a controlar como robots, pero si te digo que la gente está empezando a creer en todas las respuestas que ChatGPT arroja, no crees que podría afectarnos en un futuro lejano?

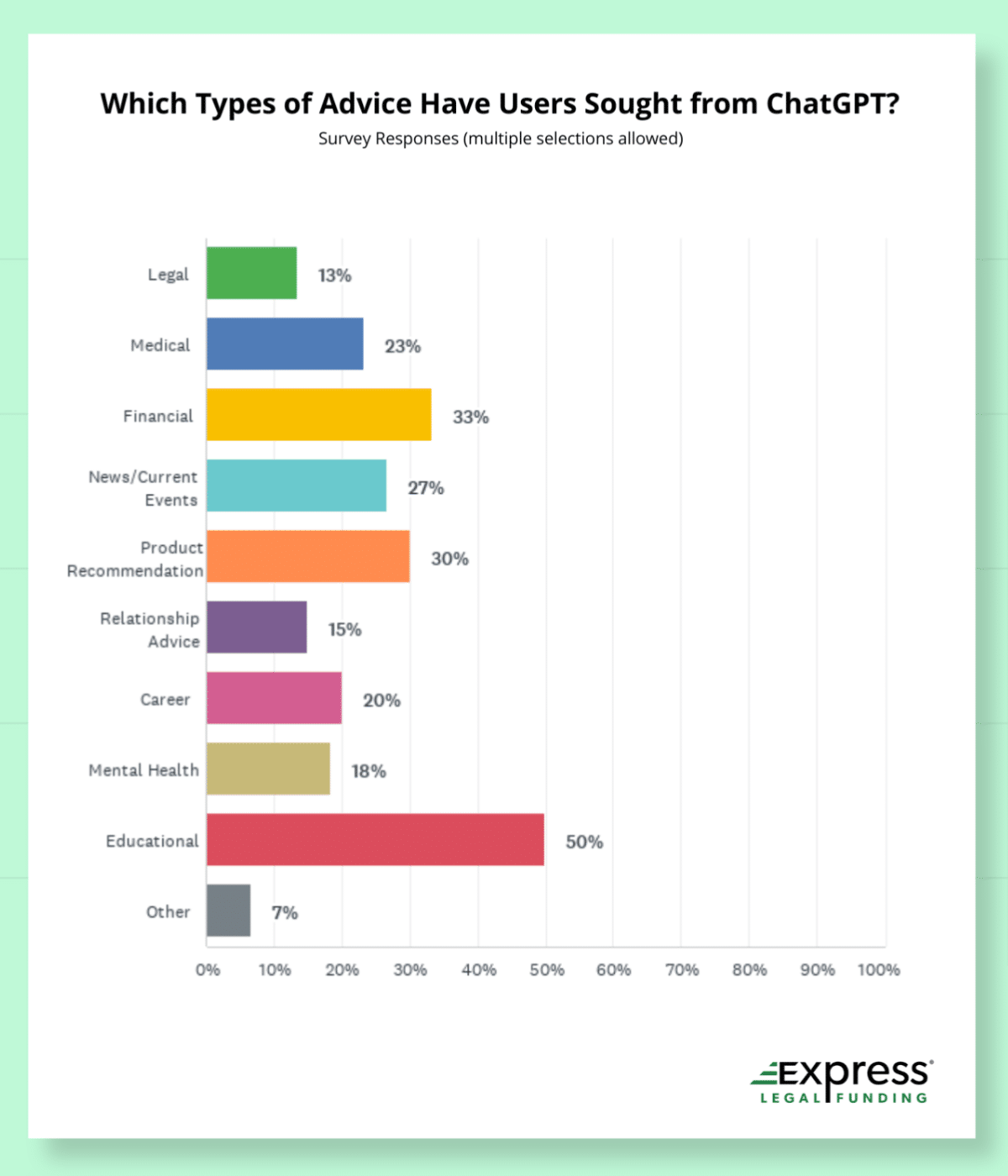

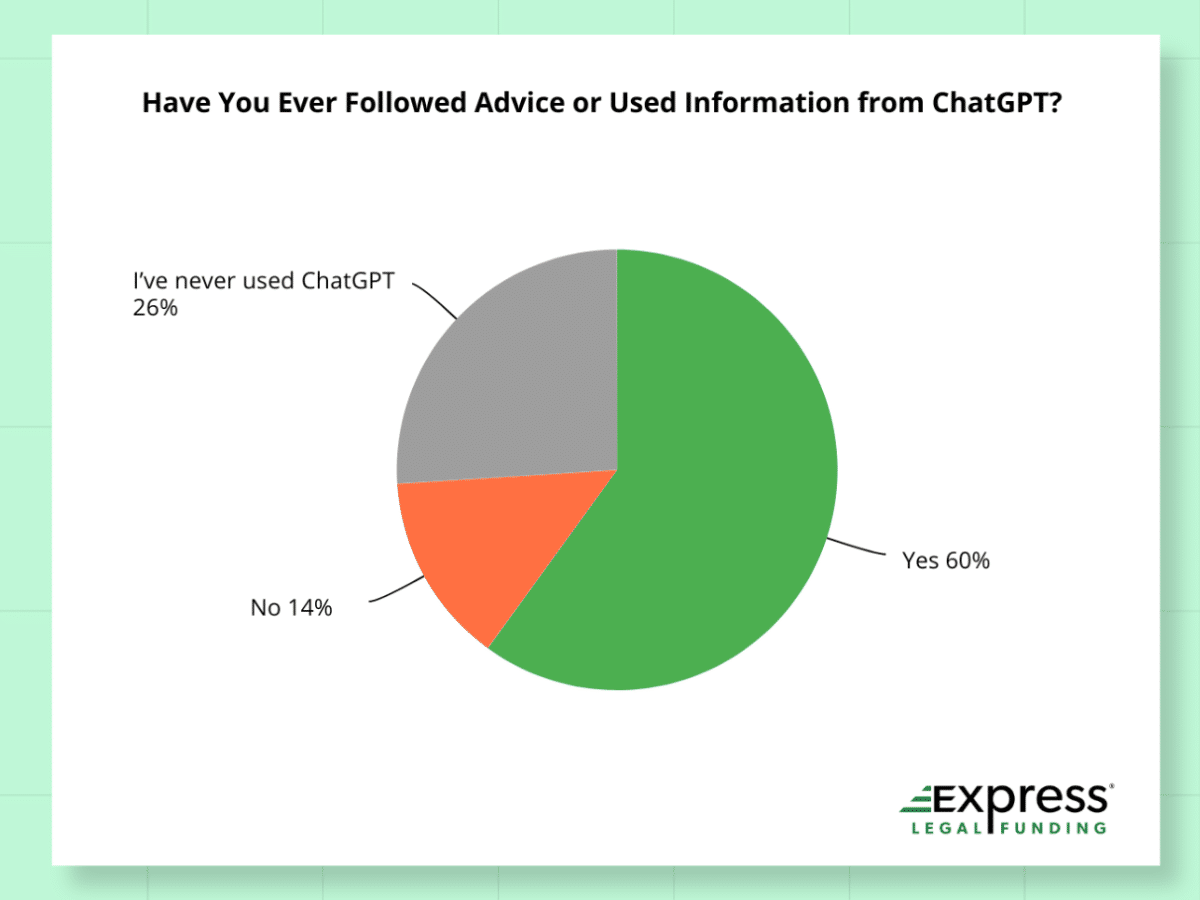

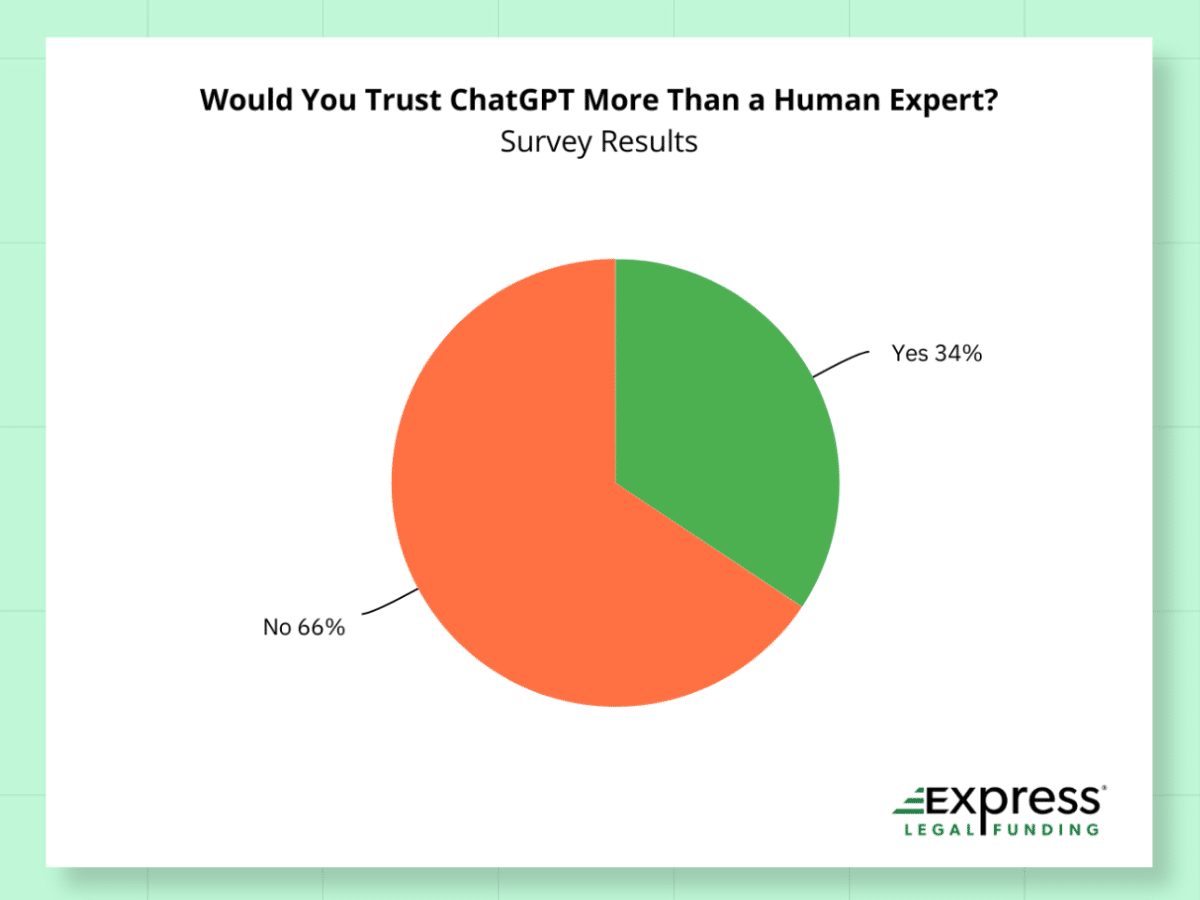

Ese estudio fue hecho por humanos en humanos, y los números creo que son alarmantes. Sabemos que ChatGPT es entrenado con la totalidad de información que está en internet, fuera de lo moral, ético o si le diste permiso o no, a su vez arroja información que no siempre es la correcta, y aún así tiene un 34% de confianza. Imaginate entonces si mañana un partner decide que OpenAI tiene que hablar bien de ciertos temas o que no puede criticar ciertos temas, estaríamos frente a un caso de no saber la verdad, y eso, es problemático para la sociedad.

Mi pequeña y humilde recomendación, es dejar de usar un sistema que nos brinda poco por lo mucho que nos cuesta. Vivimos mucho tiempo sin la necesidad de preguntarle a una computadora como escribir mejor, y eso nos motivaba a mejorar a nosotros mismos.